TensorFlow基础介绍

1.基本结构

- 计算图graph

表示计算任务

- 会话Session

表示执行计算图的上下文,执行时需要初始化所有变量(initializer),会话完成时需要关闭(sess.close)

- 张量(Tensor)

表示数据,图中的线条。包括常量constant,变量variable,以及通过占位符(placeholder),其中占位符只在运行时才放入具体的值

- 操作(op)

图中的节点,构建图包括构建数据(因为本身不保存数据)和完成计算,因此定义一个Tensor也是一个计算。

2.代码及运行方式

tf本身不完成运算,而是定义图来描述计算,把计算放在Python之外进行以提高计算效率

2.1 Tensor(张量)

张量是tensorflow里面的数据结构,可分为常量和变量,所有的数据都通过张量来表示,可以简短理解为多维数组。那么0阶张量表示一个数,1阶张量表示一个向量(即一维数组),n阶张量表示n维数组。

张量主要保存了三个属性:1.名字,2.维度,3.类型

张量中并不是直接保存数据,而是保存数据的计算过程。如下:

1 | import tensorflow as tf |

1 | import tensorflow as tf |

- 变量

变量的声明函数tf.Variable()是一个运算,是一种特殊的张量

神经网络中的参数是神经网络实现分类或者回归问题中的重要部分,变量的作用就是保存和更新神经网络中的参数(边)。

tf.Variable是一个运算,运算的输出结果是一个张量,所以变量是一种特殊的张量。

定义一个2*3矩阵变量(元素值默认为0,标准差为2的随机数):

weights=tf.Variable(tf.random_normal([2,3],stddev=2))

变量一个小应用:

1 | import tensorflow as tf |

2.2 Session(会话)

会话作用是执行定义好的运算,会话可以管理tensorflow运行时的所有资源。当所以计算完成后需要关闭会话回收资源。包含三个要点:

- 定义会话对象(tf.Session)

- 启动会话完成计算(run)

- 会话关闭(sess.close())

使用会话如下:

1 | sess = tf.Session() |

可以使用python上下文管理机制自动关闭会话:

1 | with tf.Sesssion() as sess(): |

总结:

1 | import tensorflow as tf |

2.3 placeholder(占位符)

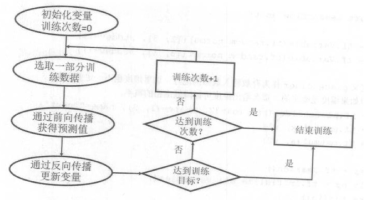

反向传播的机制就是迭代(循环执行某一个流程图)

如果每一次迭代都要用到常量,计算量就过大(一个神经元网络的训练过程需要几百万轮甚至几亿轮迭代),placeholder相当于定义了一个位置,这个位置中的数据在程序运行时再指定。和张量一样,placeholder的类型也是不可以改变的。

- 无placeholder的代码:

- 有placeholder:

- 总结:

placeholder通过一个指针来表示该节点的输入数据,这样可以在运行时再计算该节点的数据

比直接用张量来作为输入数据节省内存

需要在Session的run()中通过字典类型参数feed_dict赋值

2.4 initializer(初始化)

tf中变量是保存和更新神经网络参数的值,变量的操作分为变量定义和变量初始化

需要注意的是变量定义时只是给出变量赋值的方法,并没有被真正执行,需要通过会话初始化变量已完成赋值

1 | w1 = tf.Variable(tf.random_normal([2,3],stddev=2)) #随机数定义 |

2.5 graph(计算图)

计算图是tensorflow计算的流程图,里面包括数据和计算,其中节点代表数据,节点和节点直接的连线代表计算。可以通过不同的计算图来管理模型。

以下代码会发现不同计算图的变量值不一样,就说明不同的图是一独立的运算流程

1 | import tensorflow as tf |